Biyoloji bilimi, 21. yüzyılın başlarında benzeri görülmemiş bir paradigma kayması yaşadı. Yüzyıllar boyunca mikroskoplar, petri kutuları ve kimyasal reaktiflerle sınırlı olan biyoloji; İnsan Genom Projesi'nin (Human Genome Project) 2003 yılında tamamlanmasıyla birlikte bir "Veri Bilimi"ne (Data Science) dönüştü. Bugün bir hücreyi anlamak için sadece mikroskoba bakmak yetmiyor; milyarlarca harften (A, T, G, C) oluşan devasa metin dosyalarını incelemek, filtrelemek ve anlamlandırmak gerekiyor.

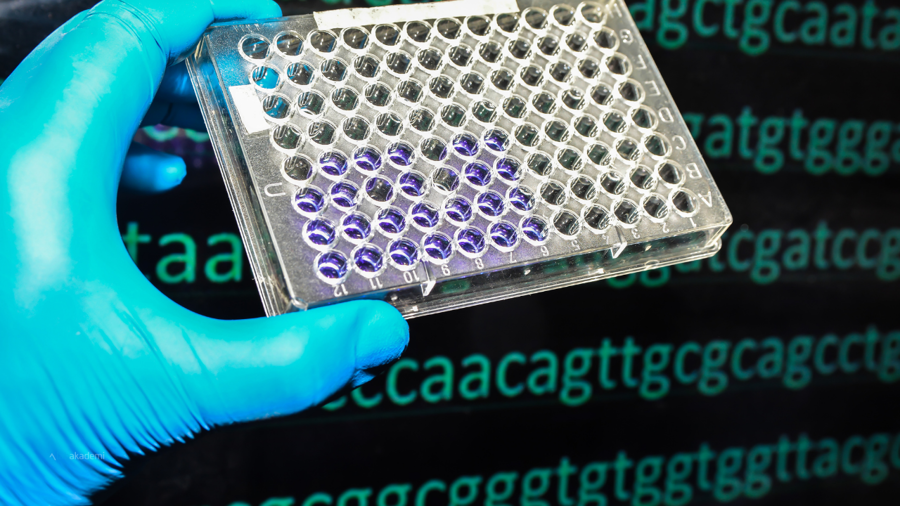

İşte biyoloji, bilgisayar bilimleri, matematik ve istatistiğin bu büyüleyici kesişim kümesine Biyoinformatik diyoruz. Bu makalede, ıslak laboratuvardan (wet lab) kuru laboratuvara (dry lab - in silico) geçişin teknik anatomisini, Yeni Nesil Dizileme (NGS) teknolojilerinin yarattığı veri patlamasını ve bu veriyi işleyen algoritmik temelleri akademik bir derinlikle inceliyoruz.

1. Veri Patlaması: Yeni Nesil Dizileme (NGS) ve "Omik" Çağı

1990'larda İnsan Genom Projesi başladığında, tek bir insan genomunu dizilemek yaklaşık 13 yıl sürmüş ve 3 milyar dolara mal olmuştu. Sanger dizileme yöntemi güvenilirdi ancak çok yavaştı. Bugün ise Yeni Nesil Dizileme (Next-Generation Sequencing - NGS) teknolojileri (Illumina, MGI, Oxford Nanopore gibi platformlar) sayesinde, tam bir insan genomu birkaç yüz dolar maliyetle, sadece birkaç saat içinde dizilenebilmektedir.

Bu teknolojik sıçrama bir "veri tsunamisi" yarattı. Bir insan genomu yaklaşık 3.2 milyar baz çiftinden oluşur. Bu veri, salt metin olarak bile gigabaytlarca yer kaplar. Bir kanser araştırmasında binlerce hastanın genomunu, transkriptomunu (aktif RNA profili) ve proteomunu karşılaştırdığınızı düşünün. Elde edilen veri Petabayt (PB) seviyelerindedir.

İşte bu devasa veri setlerini inceleyen alt dallara "Omik" teknolojiler denir:

Genomik: DNA diziliminin bütünü.

Transkriptomik: Belirli bir anda hücrede sentezlenen mRNA'ların profili (Hangi genler açık/kapalı?).

Proteomik: Üretilen proteinlerin üç boyutlu yapısı ve etkileşimleri.

Bu verileri bir Excel dosyasında açıp gözle incelemek imkansızdır. Algoritmalara, süper bilgisayarlara ve biyoinformatik araçlara ihtiyaç vardır.

2. Biyoinformatiğin Temel Algoritmaları ve Hizalama (Alignment)

Biyoinformatiğin en temel görevi, elde edilen bilinmeyen bir dizilimi (sequence), bilinen dizilimlerle karşılaştırmaktır. Buna Dizi Hizalama (Sequence Alignment) denir.

Örneğin, hastadan alınan bir tümör dokusunda daha önce görülmemiş bir gen dizilimi buldunuz. Bu genin ne işe yaradığını bulmak için, bu dizilimi dünyadaki tüm bilinen gen veri tabanlarıyla karşılaştırmanız gerekir. Bu noktada devreye BLAST (Basic Local Alignment Search Tool) algoritması girer.

BLAST, milyarlarca harflik veri tabanlarında (örneğin NCBI - National Center for Biotechnology Information) sizin diziliminize en çok benzeyen (homolog) dizilimleri saniyeler içinde bulur. Bu karşılaştırma sadece genin kimliğini değil, evrimsel akrabalığını (filogenetik ağaçlar) ve olası fonksiyonunu (protein domainleri) de ortaya çıkarır.

Lokal Hizalama (Smith-Waterman Algoritması): İki dizilim arasındaki en benzer alt bölgeleri bulur (Örn: Sadece bir protein domainini aramak).

Global Hizalama (Needleman-Wunsch Algoritması): İki dizilimi baştan sona eşleştirmeye çalışır (Örn: İki yakın akraba türün genlerini kıyaslamak).

3. Kuru Laboratuvarın Alet Çantası: Programlama Dilleri ve İşletim Sistemleri

Bir biyoinformatikçi olmak için sadece hazır web araçlarını (web-servers) kullanmak yeterli değildir. Gerçek analizler komut satırında (command line) yapılır.

Linux / Bash Scripting: Biyoinformatik dünyasının işletim sistemi Linux'tur. Milyonlarca satırlık devasa metin (FASTA veya FASTQ) dosyalarını açmadan, içindeki belirli gen dizilimlerini kesmek, kopyalamak ve filtrelemek için

grep,awkvesedgibi Linux komutları hayat kurtarır.Python: Sözdizimi (syntax) temiz ve okunabilir olduğu için biyolojiden yazılıma geçenlerin en çok tercih ettiği dildir.

Biopythongibi güçlü kütüphaneleri sayesinde DNA dizilim analizi, protein 3D yapı tahmini çok hızlı kodlanabilir.R ve Bioconductor: İstatistiksel genetik ve veri görselleştirme (Data Visualization) konusunda rakipsizdir. Özellikle Transkriptomik (RNA-Seq) verilerinde diferansiyel gen ekspresyonu (hangi gen kanserde daha çok çalışmış?) analizleri R ile yapılır.

4. İn Silico (Bilgisayar Ortamında) İlaç Tasarımı ve Moleküler Docking

Geleneksel ilaç keşfi; binlerce kimyasalın hücre kültürlerinde veya hayvanlarda yıllarca süren ve milyonlarca dolara mal olan deneme-yanılma süreçleriyle test edilmesine dayanır.

Biyoinformatik ise bu süreci Rasyonel İlaç Tasarımı (Rational Drug Design) ile kökten değiştirir. Kanserli hücrenin yüzeyindeki hedef proteinin üç boyutlu (3D) yapısı bilgisayar ortamında modellenir. Ardından, milyonlarca farklı kimyasal molekül (ligand), bilgisayar simülasyonları ile bu proteine "bağlanma" (Moleküler Docking - Kenetlenme) testine tabi tutulur. Algoritma, en iyi bağlanan ve hastalığı durdurma potansiyeli en yüksek olan 10 molekülü seçer. Islak laboratuvara sadece bu 10 molekül gider. Zaman ve maliyet %90 oranında azalır.

Sonuç

Biyoinformatik artık biyolojinin bir alt dalı değil, modern yaşam bilimlerinin tam merkezidir. Bir hastalığı tedavi etmek, kuraklığa dayanıklı bitkiler geliştirmek veya yeni bir aşı tasarlamak isteyen her araştırmacı, er ya da geç bu büyük veri okyanusuna dalmak zorundadır.

Lab Akademi Web Semineri Aboneliği kapsamındaki bu temel eğitimle, biyolojinin dijitalleşen yüzüyle tanışacak, yaşamın kaynak kodunu anlamlandıran algoritmik felsefeye ilk adımı atacaksınız.